AI語音與機器視覺開發應用系統平臺是一款集成AI語音、機器視覺、深度學習基礎、嵌入式Linux于一體的高端教學科研實驗平臺。

整個教學平臺由實驗箱高性能嵌入式主板夠成,高性能嵌入式核心板采用高性能64位ARM處理器,標配4GB DDR3內存和16GB閃存,可運行ubuntu、android、linuxqt等多種操作系統,可滿嵌入式linux和AI應用開發。

平臺采用多核高性能 AI 處理器,預裝 Ubuntu Linux 操作系統與 OpenCV 計算機視覺庫,支持 TensorFlow Lite、NCNN、MNN、Paddle-Lite、MACE 等深度學習端側推理框架。

提供多種應用外設與豐富的機器視覺、AI語音、深度學習實戰應用案例,如語音前處理(聲源定位、語音增強、語音降噪、回聲消除、聲音提取)、語音活體檢查、語音喚醒、語音識別、語音合成、自然語言處理、聲紋識別門鎖、語音智能家居、手寫字識別、人臉識別、目標檢測、端側推理框架、圖像識別、人體分析 、文字識別、人臉門禁控制、車牌道閘控制、手勢家居控制等,通過案例教學讓學生掌握計算機視覺與深度學習的基本原理和典型應用開發。

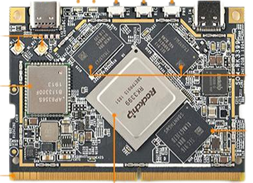

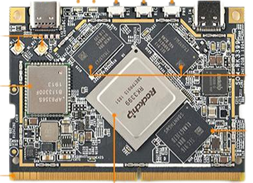

2.2.1. 嵌入式網關核心板

RK3399核心板是一款266-pin金手指形式高性能ARM計算機模塊,它采用了瑞芯微64位六核(包含雙核Cortex-A72 +四核Cortex-A53)Soc RK3399作為主處理器,標配4GB DDR3內存和16GB閃存,板載2×2 MIMO雙天線Wi Fi模組,尺寸只有69.6×50mm,模塊上帶有獨立的Typec供電接口,以及USB-C顯示接口。

RK3399計算模塊具有豐富的外設和擴展接口,可以擴展使用雙MIPI寬動態攝像頭,另外它還帶有eDP顯示接口,MIPI顯示接口,1路USB3.0,2路USB2.0,以及12C,12S,SPI,PWM,GF10和串口等各種資源。RK3399可流暢運行Android 8.1,Ubuntu 18.04,Armbian,Buildroot等主流嵌入式操作系統,軟件資源和生態非常豐富,尤其是Android 8.1具有NN SDK神經網絡加速軟件包,Qt-5.10集成了VPU硬件編解碼,GPU圖形加速,可使用QML快速開發流暢的動態式界面,因此RK3399核心板非常適合做高端人臉識別,機器視覺,VR虛擬現實,自動駕駛,深度計算分析等方面的人工智能產品快速原型及產品開發。

硬件參數:

| CPU | SOC:RK3399

核心:64位雙核Cortex-A72 +四核Cortex-A53

頻率:Cortex-A72 (2.0 ghz), Cortex-A53 (1.5 ghz) |

| GPU | Mali-T864 GPU,支持OpenGL ES1.1/2.0/3.0/3.1、OpenVG1.1 OpenCL, DX11, AFBC |

| VPU | 4K VP9 and 4K 10bits H265/H264 60fps decoding, Dual VOP, etc |

| Memory | RAM: Dual-Channel 4GB DDR3 |

| Storage | eMMC: 16GB(regular), 32GB/64GB(optional), eMMC 5.1 |

| Power Management | RK808-D PMIC,配合獨立直流/直流,啟用dvf solfware省電,RTC喚醒,系統睡眠模式 |

| Connectivity | 以太網:本機千兆以太網

wi - fi: 802.11 a / b / g / n / ac

藍牙:4.1雙模式

天線:雙天線接口 |

| Video Input | 1個或兩個4-Lane MIPI-CSI,雙重ISP, 13 mpix / s,同時支持雙相機數據的輸入 |

| Video Output | HDMI: HDMI 2.0a, supports 4K@60Hz,HDCP 1.4/2.2

DP on Type-C: DisplayPort 1.2 Alt Mode on USB Type-C

LCD Interface: one eDP 1.3(4-Lane,10.8Gbps), one or two 4-Lane MIPI-DSI |

| USB | USB 2.0: 2獨立的本地主機USB 2.0

USB 3.0: 1本地主機USB 3.0

USB c類型:支持USB3.0 c型和顯示端口1.2 Alt模式USB c型 |

| PCIe | PCIe x4, compatible with PCIe 2.1, Dual operation mode |

| 調試 | 1 x調試UART, 3 v級,1500000個基點 |

| LED | 1x Power LED(Red) 1x GPIO LED(Green) |

| Key | Power Key x1 Reset Key x1 Recovery Key x1 |

| 工作溫度 | -20℃ to 70℃ |

| 電源 | 直流12 v / 1(邊緣連接器)或DV 5 v / 2.5 (c型) |

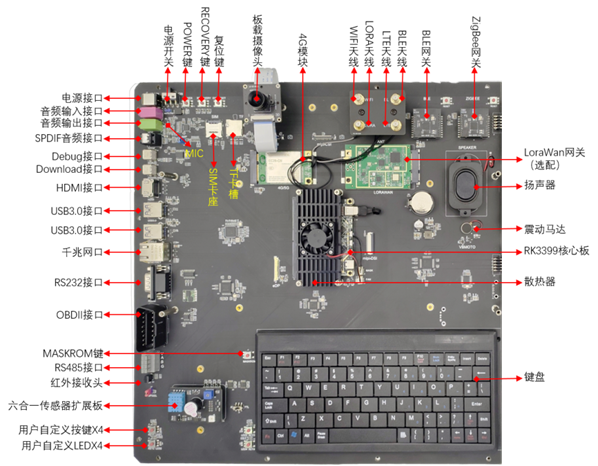

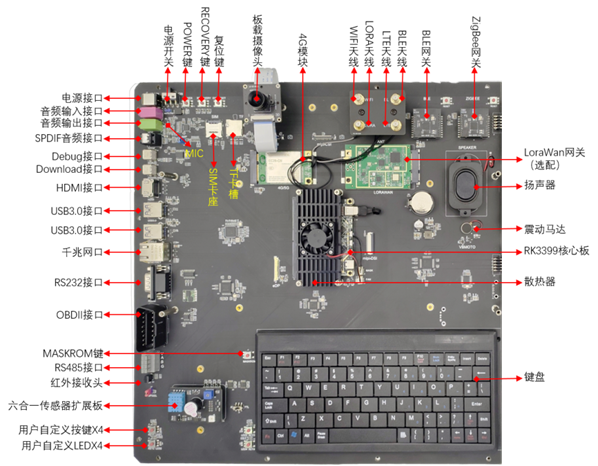

2.2.2. 網關底板其他外設

l 11.6寸高清觸顯一體屏:板載,eDP接口,電容式多點觸摸,分辨率1920*1080

l 按鍵:板載重啟、恢復、電源3個功能按鍵,4個用戶自定義按鍵

l UART:1路RS232,1路RS485

l 以太網:100/1000M

l 音頻:音頻輸出接口、MIC音頻輸入接口、板載4歐3W揚聲器

l 無線網:WiFi (2.4G and 5G, 802.11 ac), Bluetooth 4.1

l 4G模組:板載,板載EC20模組

l LoRaWAN網關模塊接口:板載mini-pcie接口,可接入SX1301八通道并行LoRaWAN網關模塊。1個項目須至少配備1個LoRaWAN網關模塊,以實現對實驗室所有lora節點的接入管理。

l Zigbee網關模塊:板載,直列雙排20芯插針接口,非usb接口。

l BLE網關模塊:板載,直列雙排20芯插針接口,非usb接口。

l USB 3.0 HOST接口:板載2個

l Debug接口:板載1個

l Download接口:板載1個

l 鍵盤:板載7寸80鍵標準鍵盤

l 高清相機模組:CMOS傳感器OV13850,MIPI信號輸出,400萬像素,最高支持2688x1520像素。

l 麥克風陣列:板載7顆數字高性能硅麥克風。

l 紅外接收:板載紅外接收模塊1個

l 震動馬達傳感器:1個

l LED:板載4顆藍色LED燈珠。

l 天線接口:板載wifi、BLE、lora、LET 共4個天線接口。

l 傳感器擴展接口:板載,與無線傳感器節點的傳感器模塊接口兼容,可完成linux系統下的傳感器驅動開發實驗。

l OBD接口:板載,標準16針OBD-II插座,與配套軟件結合可完成基于CAN總線通信相關實驗。

l

電源:DC 9-12V輸入

l 其他接口:MIPI、GPIO、SPI、I2C、TF Card (sd/mmc 3.0)、SIM卡座、USB 2.0 HOST、USB Type-C (with DP out)、eDP 1.3、HDMI 2.0 for 4K 60Hz

2.3. 外設模塊

2.3.1.

4G LTE模塊l 網絡:FDD-LTE/TDD-LTE/WCDMA/TD-SCDMA/GSM/EDGE;

l 制式:CMCC/CUCC(B1/B3/B8/B34/B38/B39/B40);

l 工作頻帶:HSPA1900/2100,GSM 900/1800;

l 高速USB 2.0接口、PCI-E接口;

l 支持短信、數據、電話本、PCM語音功能;

l 支持IPv4,IPv6協議;

l 支持LTE多頻;

l 支持最大150M/50Mbps的理論上下行數據傳輸速率;

2.3.2. AI麥克風陣列

l 7路麥克風陣列,提供聲源定位、語音增強、語音降噪、回聲消除、聲音拾取等功能。

l 帶硬件浮點運算的RISC-V 雙核64位處理器,主頻最高800MHz。

l 具備機器聽覺能力和語音識別能力,內置語音處理單元(APU)。

l 具備卷積人工神經網絡硬件加速器KPU,可高性能進行卷積人工神經網絡運算。

l 麥克風陣列模塊集成TFT彩屏屏,能夠直觀顯示音頻頻譜圖。

l 內置ARM STM32 USB音頻驅動芯片,提供USB聲卡驅動,開放源代碼。

l 接口:雙列直插封裝/USB,需能夠接入到eAIOT平臺使用。

l 支持語音識別、語義理解、語音合成、人機對話等功能,可與硬件進行語音交互。

l 5米監測范圍、基于linux系統。

2.3.3. AI攝像頭

l 1/1.8" SONY Exmor CMOS

l 有效像素200萬像素,30幀@1920*1080

l C/CS鏡頭接口,最低照度0.001 Lux,120dB TWDR

l 支持協議:PROFILE S,GB/T28181,FTP/RTSP.UPNP等

l 支持雙碼流、手機監控、心跳機制,具3D降噪、去霧、數字寬動態、鏡頭校正、走廊監控等智能模式

l 提供基于eAIOT教學平臺的人臉識別系統案例。

2.4. 物聯網應用基礎云平臺

1、功能簡介

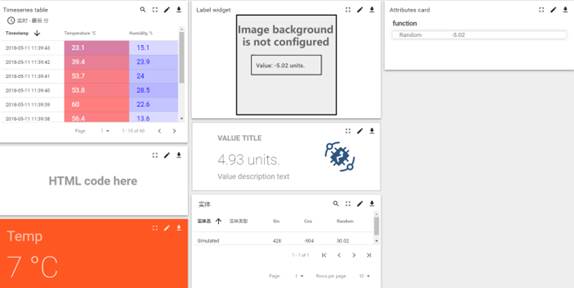

1)學生能夠將物聯網感知層設備(傳感器、執行器等)接入物聯網云服務平臺,平臺能夠接收并存儲傳感器和執行器的實時數據,模塊在線狀態,并實時顯示。

2)提供后臺管理系統,能夠設置賬號類型和使用權限。支持多用戶管理及權限控制,分為父用戶和子用戶,父用戶可以創建多個子用戶,并且可以為每個子用戶分配增、刪、改幾種權限,子用戶創建的資源相互隔離。

3)提供物聯網規則編輯器,無需編寫代碼即可編輯復雜的自動化控制策略,實現移動互聯網系統的自動化控制。

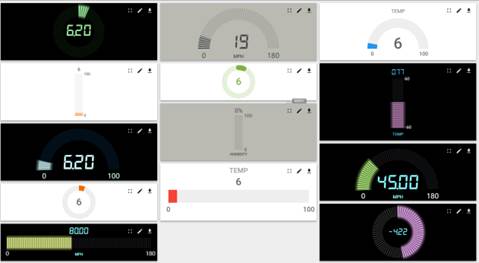

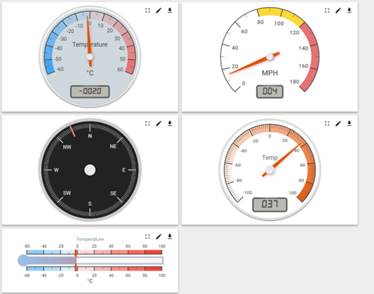

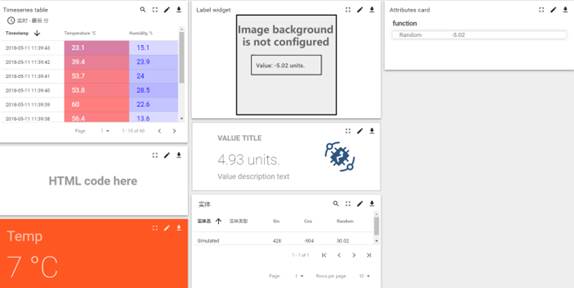

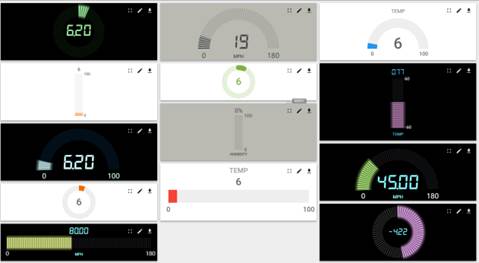

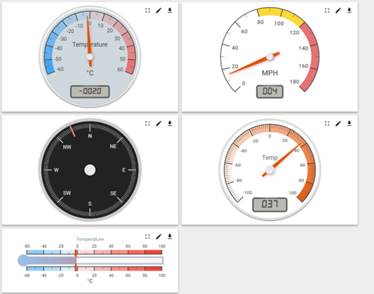

4)提供豐富的可視化控件庫,通過拖拽、簡便配置即可完成美觀的UI設計。支持GIS地圖、曲線圖、柱狀、餅圖、圖表、按鈕、儀表圖等控件。

5)物聯網感知層設備也能夠向執行器發送控制命令,系統能夠實現模塊的在線監測。

6)云平臺支持物聯網硬件多協議接入,通過ZigBee/BLE/wifi/lora/NBIOT無線技術取得傳感器采集的數據,形成一個完整的無線傳感器網絡。

7)數據通過http/MQTT協議傳輸至物聯網應用基礎云平臺軟件,進行數據圖形化展示。

8)實現基于云平臺的智能家居實驗,并包含配套完整的教學資源。

9)支持本地化部署和云端部署兩種方式。

10)提供“物聯網應用基礎云平臺”軟件著作權登記證書及軟件產品登記測試報告復印件并加蓋公章,原件備查。

3. 部分實驗案例

3.1.1. 嵌入式linuxQT綜合實驗

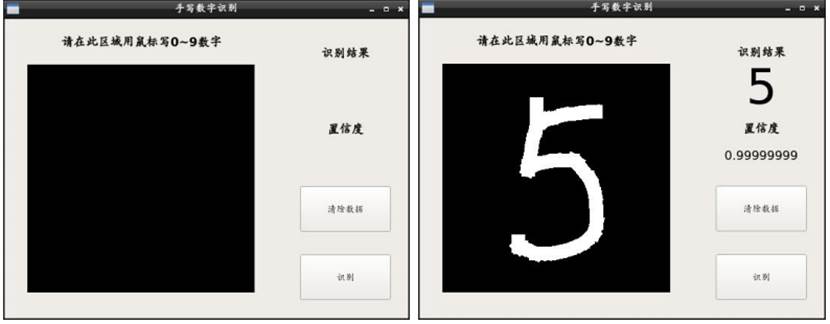

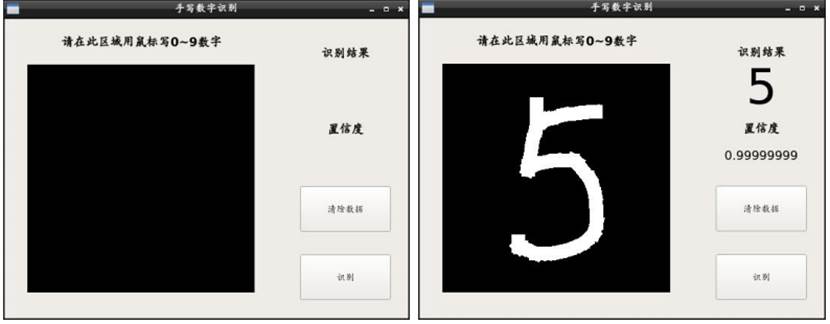

3.1.2. 手寫字識別

學習設計一個神經網絡模型,然后用已經標注過的MNIST數據來訓練這個模型,然后進行測試驗證。

圖:手寫字識別案例

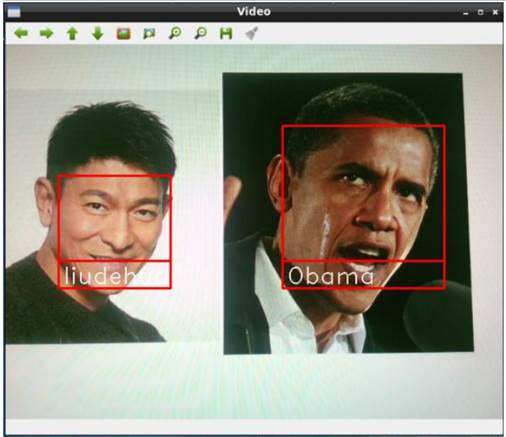

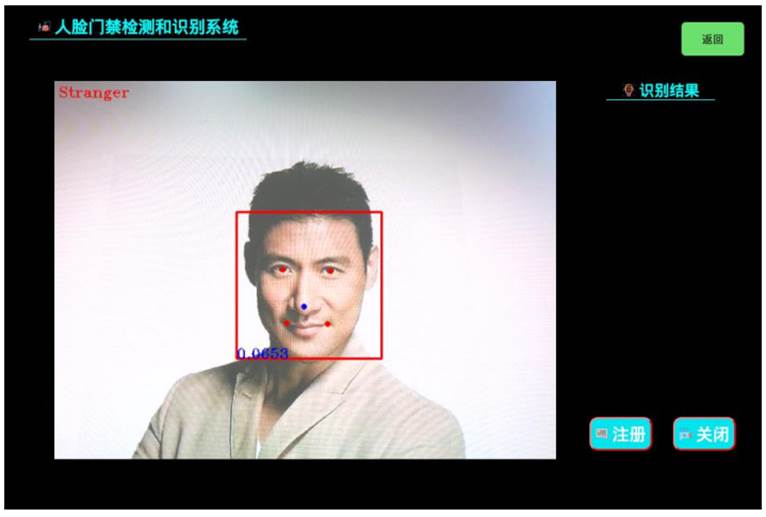

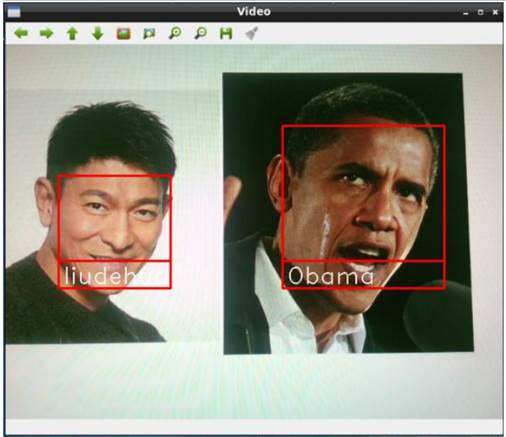

3.1.3. 人臉識別

通過OpenCV自帶的分類器、OpenCV的深度學習分類器是基于SSD(Single Shot Detector)框架的ResNet網絡,實現在圖片、視頻中對人臉的檢測,并用矩形框框出來。

學校可用于身份識別、課堂/上下班考勤、會議簽到、刷臉支付、門禁通行、安防監控相關場景。

圖: 人臉識別案例

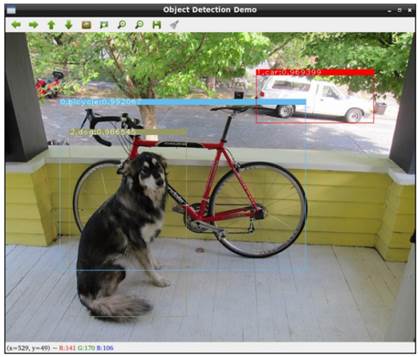

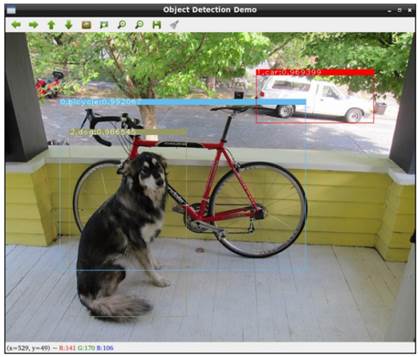

3.1.4. 目標檢測

利用深度學習框架caffe,實現對常見物體的檢測。

圖:目標檢測案例

3.1.5. 人體姿態識別

使用邊緣側推理框架Tengine檢測圖像中的所有人體并返回每個人體的矩形框位置,精準定位 21 個核心關鍵點,包含五官、四肢、脖頸等部位,更多關鍵點持續擴展中;支持多人檢測、人體位置重疊、遮擋、背面、側面、中低空俯拍、大動作等復雜場景。

圖:人體姿態識別案例

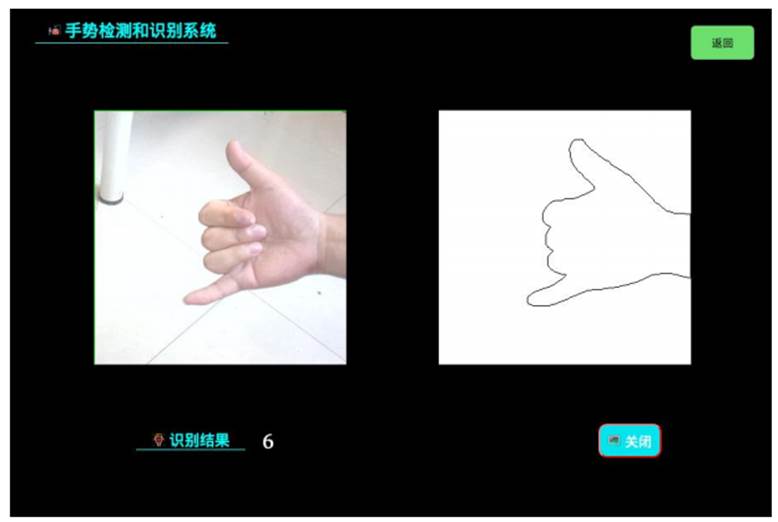

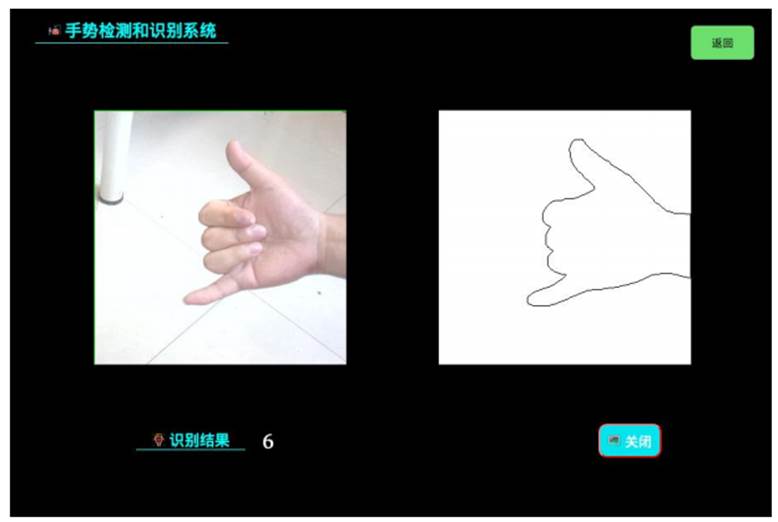

3.1.6. 手勢識別

利用深度學習框架caffe,實現對簡單手勢的識別。

圖:手勢檢測和識別系統案例

3.1.7. 車牌識別

使用opencv 的 HAAR Cascade 檢測車牌大致位置,使用卷積神經網絡回歸車牌左右,然后使用卷積神經網絡滑動窗切割字符、及識別字符。

圖:交通門禁車牌檢測和識別系統案例

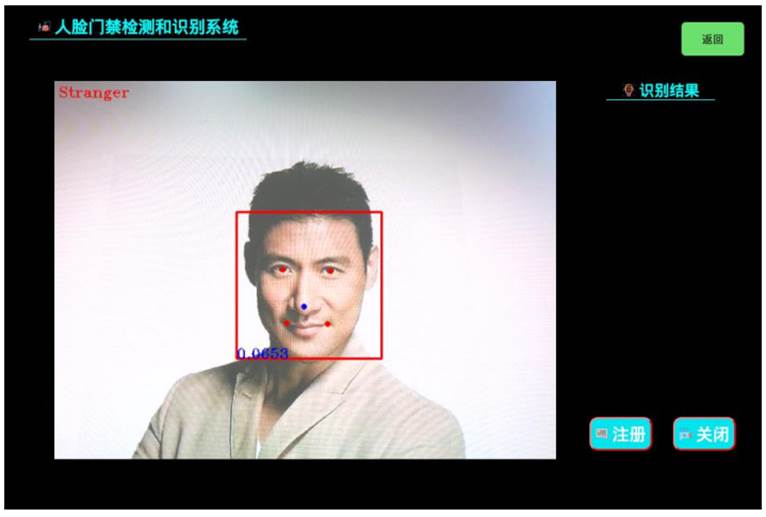

3.1.8. 人臉門禁

采用 mtcnn 進行人臉檢測,采用MobileFaceNet 進行人臉識別,然后用活體檢測算法進行檢測。

圖:人臉門禁檢測和識別系統案例

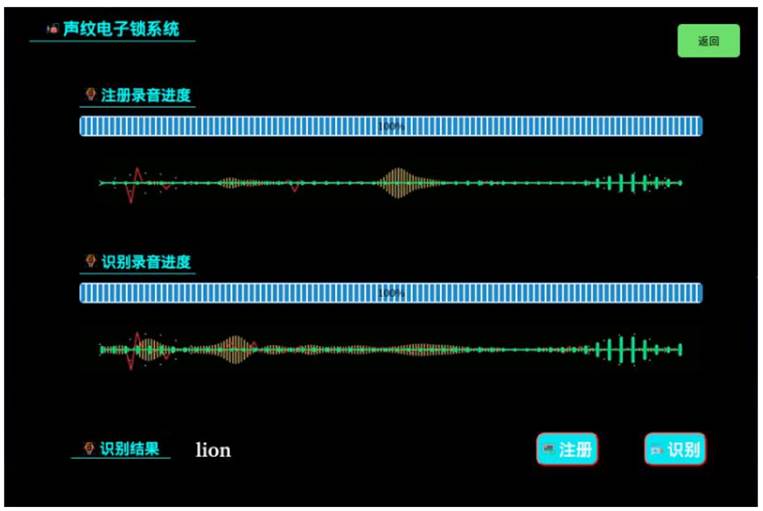

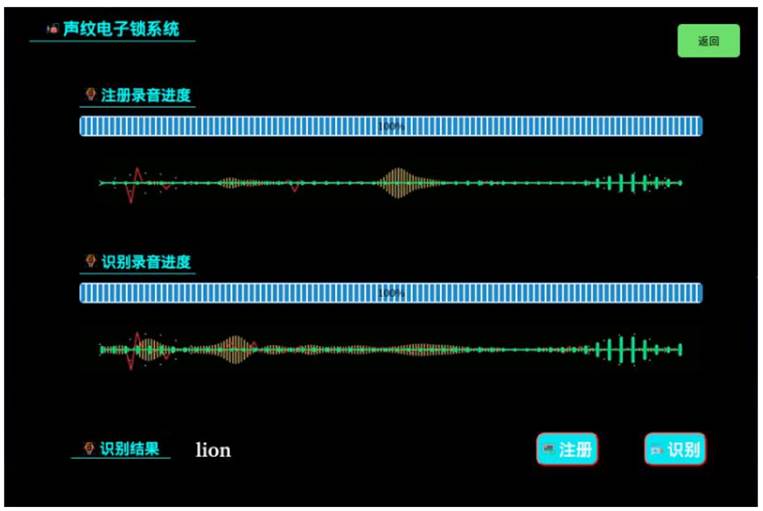

3.1.9. 聲紋鎖實驗

通過語音增強、語音質量檢測、語音增強、有效語音提取、聲紋特征提取等步驟,完成聲紋注冊及聲紋驗證。

圖:聲紋電子鎖系統案例

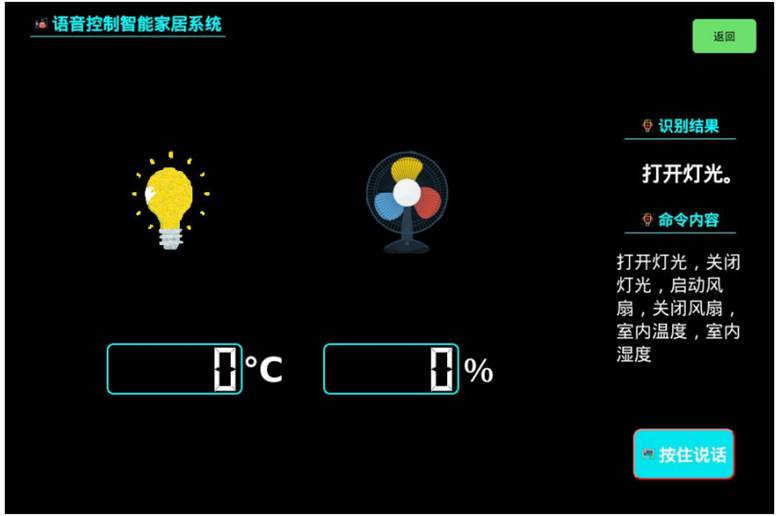

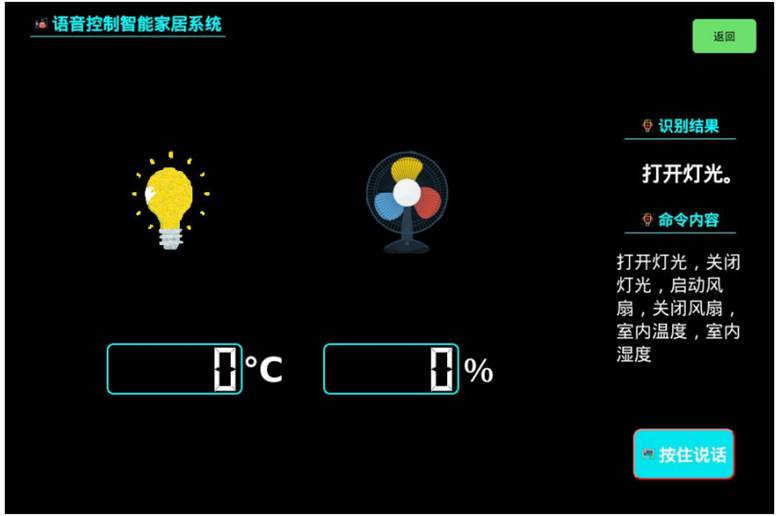

3.1.10. AI語音控制智能家居

本系統實現語音數據高速傳輸,基于百度語音識別 API 完成語音識別,并用無線方式控制電燈,電風扇,以及獲取溫度和濕度。

圖:語音控制智能家居系統案例

3.1.11. 知識圖譜和聊天機器人

知識圖譜融合了兩千五百多萬的實體,擁有億級別的實體屬性關系,機器人采用了基于知識圖譜的語義感知與理解,致力于最強認知大腦。自然語言處理工具包的功能有:中文分詞、詞性標注、命名實體識別、關鍵詞提取、文本摘要、新詞發現、情感分析等。

圖:知識圖譜和文本聊天機器人系統案例

4. 招標參數

| 序號 | 項目名稱 | 項目技術指標 | 備注 |

| 1 | 名稱:AI人工智能語音機器視覺開發應用系統平臺

型號:DB-SD38 | 本項目實驗系統采用CPU+GPU雙處理器架構,是一款集成AI語音、機器視覺、深度學習基礎、嵌入式Linux于一體的高端教學科研實驗平臺。

整個教學平臺包括人工智能(AI)和嵌入式Linux部分,兩部分互相支撐、互為補充,共同實現嵌入式人工智能。人工智能部分的硬件基于嵌入式ARM控制器、高清相機模塊、7麥麥克風陣列,具備語音、圖像數據的采集和處理能力及適用于多種場景的控制接口;嵌入式Linux部分的硬件采用CPU+GPU雙處理器架構,配備高清大屏以及豐富的外設接口。

平臺采用多核高性能 AI 處理器,預裝 Ubuntu Linux 操作系統與 OpenCV 計算機視覺庫,支持 TensorFlow Lite、NCNN、MNN、Paddle-Lite、MACE 等深度學習端側推理框架。

提供多種應用外設與豐富的機器視覺、AI語音、深度學習實戰應用案例,如語音前處理(聲源定位、語音增強、語音降噪、回聲消除、聲音提取)、語音活體檢查、語音喚醒、語音識別、語音合成、自然語言處理、聲紋識別門鎖、語音智能家居、手寫字識別、人臉識別、目標檢測、端側推理框架、圖像識別、人體分析 、文字識別、人臉門禁控制、車牌道閘控制、手勢家居控制等,通過案例教學讓學生掌握計算機視覺與深度學習的基本原理和典型應用開發。

一、硬件技術參數

★1、處理器:

CPU: RK3399:六核 Dual Cortex-A72 + Quad Cortex-A53, 64-bit CPU at 1.8GHz

GPU: Mali-T864 GPU,支持 OpenGL ES 1.1/2.0/3.0/3.1, OpenVG 1.1, OpenCL, DX11

2、存儲器:雙通道LPDDR3(64-bit)不低于4GB,16GB 高速emmc 擴展存儲,MicroSD不低于64G

3、高清相機模組:CMOS傳感器OV13850,MIPI信號輸出,1300萬像素,最高支持4224x3136像素。

4、AI高清攝像機:有效像素500萬像素,對焦方式自動對焦,USB2.0接口,提供基于eAIOT教學平臺的人臉識別系統案例。

★5、11.6寸板載高清觸顯一體屏:11.6寸eDP接口,分辨率不低于1920*1080

★6、1)Zigbee網關模塊接口:板載,采用直列雙排20芯插針牢靠固定,非usb接口。

2)BLE網關模塊接口:板載,采用直列雙排20芯插針牢靠固定,非usb接口。

7、4G模組:板載EC20模組,支持LTE TDD/LTE FDD/TD-SCDMA/WCDMA /TD-SCDMA/CDMA2000/CDMA/GSM等頻段

★8、7路麥克風陣列:

1)7路麥克風陣列,提供聲源定位、語音增強、語音降噪、回聲消除、聲音拾取等功能。(需提供完整硬件原理圖及PCB文件截圖證明為自主研發產品)

2)主控芯片K210,RISC-V 雙核64位處理器,主頻最高800MHz。集成卷積神經網絡加速器KPU,峰值算力1TOPS。

3)一體化單板設計,集成TFT彩色液晶屏,能夠直觀顯示彩色音頻頻譜圖。

4)集成 STM32音頻驅動芯片,提供USB聲卡驅動,開放源代碼。(提供源碼工程截圖,源碼備查)

5)采用雙列直插封裝和USB接口輸出,需能夠接入到系統主板中使用。

6)5米監測范圍,基于linux系統。

★9、OBD接口:板載,標準16針OBD-II插座,與配套軟件結合可完成基于CAN總線通信相關實驗。

10、天線接口:板載wifi、BLE、lora、LTE共4個天線接口。

11、其他硬件接口:

1)UART:1路RS232,1路RS485

2)以太網:100/1000M

3)音頻:音頻輸出接口、MIC音頻輸入接口、板載4歐3W揚聲器

4)無線網:WiFi (2.4G and 5G, 802.11 ac), Bluetooth 4.1

5)USB 3.0 HOST接口:板載2個

6)Debug接口:板載1個、Download接口:板載1個

7)鍵盤:板載7寸80鍵標準鍵盤

8)紅外接收:板載紅外接收模塊1個

9)傳感器擴展接口:板載,與無線傳感器節點的傳感器模塊接口兼容,可完成linux系統下的傳感器驅動開發實驗。

10)按鍵:板載重啟、恢復、電源3個功能按鍵,4個用戶自定義按鍵 LED:板載4顆藍色LED燈珠

11)震動馬達傳感器:板載1個

12)其他接口:MIPI、GPIO、SPI、I2C、TF Card (sd/mmc 3.0)、SIM卡座、USB 2.0 HOST、USB Type-C (with DP out)、eDP 1.3、HDMI 2.0 for 4K 60Hz

12、實驗箱箱體:單層一體式設計,左邊固定安裝實驗所需硬件,右邊收納放置配套電源適配器、線材、配件等設備。

二、軟件規格參數要求

★1、操作系統:Linux+QT、Ubuntu18.04、Android8.1,支持Linux+QT、Ubuntu雙操作系統SD卡快速離線切換,方便教學管理;

★2、須配備LoRaWAN NS(network server)實驗軟件,配合硬件可實現LoRaWAN雙向通信實驗,實驗可以顯示無線通信頻率值、擴頻因子、RSSI(接收信號強度)、信噪比、fcnt等信息。通過實驗可以快速評估和測試LoraWan協議下的數據通信格式、通信距離、信號質量等,同樣也可以基于現有的樣例進行二次開發快速完成課程設計、項目開發、科研等。

★3、提供嵌入式深度學習框架Tengine:針對 ARM CPU 及 ARM Mali GPU 優化,支持 Caffe/TensorFlow/MXnet/ONNX 模型文件,兼容 Caffe/TensorFlow API,以插件方式支持底層算子擴展,支持 INT8 量化。

★4、提供物聯網應用基礎云平臺:

1)學生能夠將物聯網感知層設備(傳感器、執行器等)接入物聯網云服務平臺,平臺能夠接收并存儲傳感器和執行器的實時數據,模塊在線狀態,并實時顯示。

2)提供后臺管理系統,能夠設置賬號類型和使用權限。支持多用戶管理及權限控制,分為父用戶和子用戶,父用戶可以創建多個子用戶,并且可以為每個子用戶分配增、刪、改幾種權限,子用戶創建的資源相互隔離。

3)提供物聯網規則編輯器,無需編寫代碼即可編輯復雜的自動化控制策略,實現移動互聯網系統的自動化控制。

4)提供豐富的可視化控件庫,通過拖拽、簡便配置即可完成美觀的UI設計。支持GIS地圖、曲線圖、柱狀、餅圖、圖表、按鈕、儀表圖等控件。

5)物聯網感知層設備也能夠向執行器發送控制命令,系統能夠實現模塊的在線監測。

6)云平臺支持物聯網硬件多協議接入,通過ZigBee/BLE/wifi/lora/NBIOT無線技術取得傳感器采集的數據,形成一個完整的無線傳感器網絡。

7)數據通過http/MQTT協議傳輸至物聯網應用基礎云平臺軟件,進行數據圖形化展示。

8)支持本地化部署和云端部署兩種方式。

★5、人工智能麥克風陣列語音前處理軟件:

1)需支持以下實驗并提供所有源代碼:聲源定位、語音增強、語音降噪、回聲消除、聲音拾取實驗。

三、實驗教學課程資源

★平臺提供成套教學資源,用戶可以按照學期長度和實際教學情況安排教學,須配備實驗指導書,實驗指導書可以提供10~18周、每周2~6節課的教學實驗需要。包含但不限于以下知識實驗課程:

Linux 實驗列表

初識linux 系統:Ubuntu 系統安裝、Ubuntu 系統入門、Ubuntu 終端操作、Shell 操作、APT 下載工具、Ubuntu 下文本編輯、Linux 文件系統、Linux 用戶權限管理、Linux 磁盤管理

Linux應用開發基礎:編寫 HelloWorld 代碼、編譯 HelloWorld、GCC 編譯器、Makefile文件

ARM Linux 開發基礎:RK3399開發平臺介紹、開發環境搭建、關于ARM架構、AArch64匯編基礎、RK3399啟動方式詳解、匯編LED燈試驗、C語言版LED燈實驗

基于SDK開發Uboot,kernel,rootfs:SDK 基礎、U-Boot 頂層 Makefile 詳解、U-Boot 啟動流程詳解、U-Boot 圖形化配置及其原理、Linux 內核頂層 Makefile詳解、buildroot根文件系統構建

linux 設備驅動程序開發基礎:字符設備驅動開發、嵌入式 Linux LED 驅動開發實驗、新字符設備驅動實驗、Linux 設備樹、設備樹下的 LED 驅動實驗、pinctrl 和 gpio 子系統實驗、Linux 并發與競爭、Linux 并發與競爭實驗、Linux 按鍵輸入實驗、Linux 內核定時器實驗、Linux 中斷實驗、Linux 阻塞和非阻塞 IO 實驗、異步通知實驗

linux 設備驅動程序開發進階:platform 設備驅動實驗、設備樹下的 platform 驅動編寫、Linux 自帶的 LED 燈驅動實驗、Linux MISC 驅動實驗、Linux INPUT 子系統實驗、Linux RTC 驅動實驗、Linux I2C 驅動實驗、Linux SPI驅動實驗、Linux misc雜項設備驅動實驗

Linux 無線通信編程實驗:lorawan NS實驗、Linux網絡編程試驗、嵌入式 Web 服務器試驗、IOT云服務實驗

嵌入式 Linux QT開發

Qt簡介:Qt環境搭建

Qt編程基礎:Qt用到的開發工具、Qt編程涉及的術語和名詞、Qt Creator的初步使用、第一個Qt程序、Qt項目管理文件、Qt項目界面文件、Qt項目中的main主函數、Qt界面布局管理、Qt信號與槽機制、Qt Creator使用技巧

Qt應用開發實例:QCalculator計算器應用實驗、QClock實時時鐘應用實驗、QLed LED控制應用實驗、QSht20溫濕度計應用實驗、QFileview文件瀏覽應用實驗、QReader文本閱讀器應用實驗、QTest綜合測試應用實驗、添加應用到系統桌面

人工智能實驗列表-基礎

神經網絡的基本工作原理:神經網絡的基本工作原理

神經網絡中的基本概念:線性反向傳播實驗、非線性反向傳播實驗、梯度下降實驗、損失函數實驗

神經網絡之回歸問題:單變量線性回歸、多變量線性回歸

神經網絡之分類問題:線性二分類、線性多分類、神經網絡非線性二分類、神經網絡非線性多分類

神經網絡模型的推理與部署:測試訓練結果實驗、查看模型文件實驗、ONNX模型文件制作實驗、模型部署和測試實驗

深度神經網絡:深度神經網絡框架設計、深度神經網絡應用、神經網絡優化、神經網絡過擬合問題

卷積神經網絡:卷積神經網絡概述、卷積的前向計算、卷積的反向傳播、池化的前向計算與反向傳播、經典的卷積神經網絡模型、MNIST分類實驗、Fashion-MNIST分類實驗

循環神經網絡:普通循環神經、通用的循環神經網絡模型實驗網絡、兩個時間步的循環神經網絡實驗、四個時間步的循環神經網絡、不定長時序的循環神經網絡實驗、深度循環神經網絡、雙向循環神經網絡、高級循環神經網絡

人工智能實驗列表-圖像

圖像采集:USB攝像頭圖像采集

圖像處理:圖片顯示、色彩空間、像素運算、ROI與泛洪填充、濾波與模糊操作、圖像直方圖、模板匹配、圖像二值化、圖像金字塔、圖像梯度、Canny邊緣檢測、直線檢測、圓檢測、輪廓發現

傳統機器視覺:手寫字識別、人臉檢測、目標檢測

深度學習機器視覺:手寫字識別、人臉檢測、目標檢測、 端側推理框架

云端機器視覺應用:圖像識別實驗、文字識別、人體分析

圖像視覺綜合應用:人臉門禁控制、車牌道閘控制、手勢識別

人工智能實驗列表-語音

語音處理 :語音采集和播放實驗、語音編碼和解碼實驗、語音變速變調實驗、語音活性檢測實驗、語音喚醒實驗、語音識別實驗、語音合成實驗

自然語言處理:中文分詞實驗、關鍵詞提取實驗、文本可視化實驗、文本向量化實驗、文本分類實驗、文本聚類實驗、文本情感分析實驗、句法依存分析實驗、構建聊天機器人實驗

云端語音語言應用:云端語音合成實驗、云端語音識別實驗、云端對話情緒識別實驗、云端新聞摘要實驗、云端短文本相似度實驗、云端情感傾向分析實驗、云端地址識別分析實驗

語音語言綜合應用:構建知識圖譜和聊天機器人實驗、聲紋識別門禁實驗、AI語音智能家居實驗 |

|